Ich würde den Fader (im Fairlight Mixer) für deine Anwendung in der Ausgangsstellung (unity) belassen (übrigens Doppelklick auf den Fader und er springt zurück in unity, macht das Leben einfacher 😉).

Theoretisch kannst du natürlich den Fader nutzen. Der Fader beeinflusst auch sämtliche Inserts/Plugins die in der Signalkette vor ihm liegen (Pre-Fader-Inserts). Das ist nützlich, um diese gezielt mit anzusprechen oder eben nicht.

Ohne Verwendung jeglicher Dynamik Plugins etc. kannst du dir das aber eigentlich sparen und das ganze über die Volume des einzelnen Audio steuern, was dir stellenweise auch mehr Präzision erlaubt, da der Fader sich ja immer auf die gesamte Spur und nicht nur auf einzelne Events (in diesem Fall Audiofiles) auswirkt.

Außerdem wird es schnell ein bisschen umständlich mit dem Fader präzise zu arbeiten, wenn du dich zu weit von +-10 dB entfernst.

(Dezibel bezogen auf Schalldruck ist ja schließlich kein linearer sondern ein logarithmischer Wert: +6 dB = doppelter Schalldruck; ca. +10 dB = doppelt empfundene Lautstärke!

Heißt also -10 dB = doppelt so laut wie -20 dB. 0 dB = doppelt so laut wie -10dB und daher viermal so laut wie -20 dB, usw. )

nun stelle ich die Lautstärke der Audiospur nur im Edit-Tab ein und messe im Fairlight-Tab jedes Mal neu

Du bist dir bewusst, dass du die Lautstärke/Volume der Soundfiles auch in Fairlight ändern kannst, ohne den Fader bedienen zu müssen, nicht wahr? (Ich frage, weil du davon sprichst, in den Edit Tab zurückzugehen, um die Volume zu ändern.)

Nur für den Fall, dass das unklar ist (und ich hoffe mir wird vergeben, wenn ich wieder zu triviale Dinge erkläre, scheint momentan mein Vibe zu sein, habe ich mir an anderer Stelle sagen lassen...):

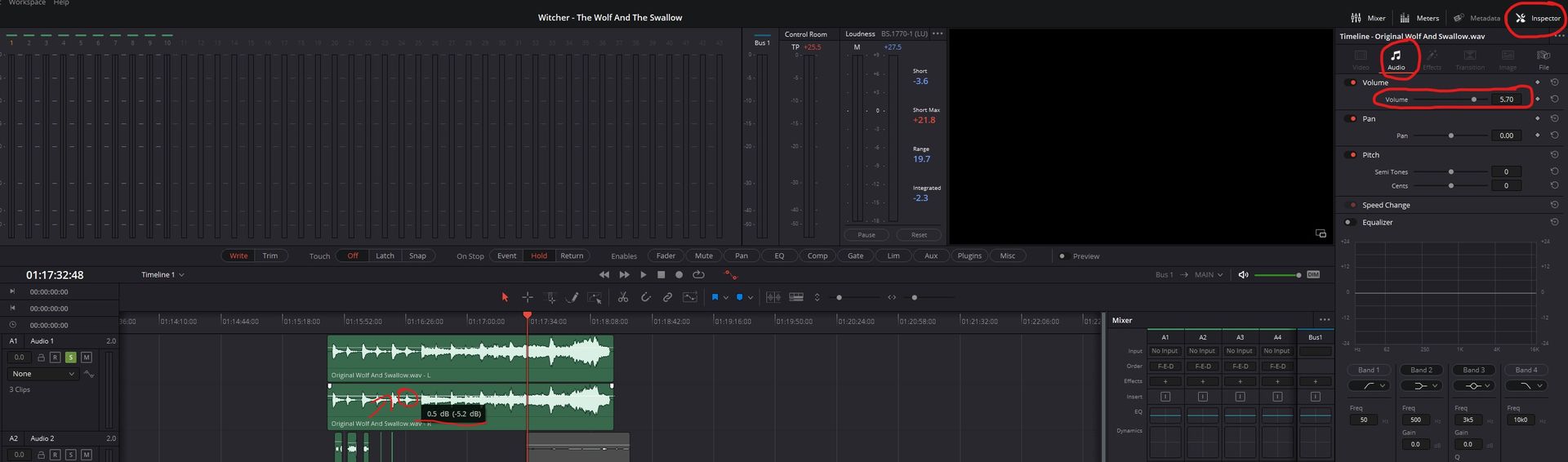

In Fairlight auf das entsprechende Event (bspw. die Soundfile in Waveform) klicken, rechts oben den "Inspector" öffnen und einfach unter "Audio" die "Volume" ändern. Also genau wie im Edit Tab auch. (Kannst natürlich auch in der Waveform die Volume-Linie packen und schieben, ist aber unpräzise)

Ich persönlich würde gar nicht versuchen so knapp wie irgend möglich an die -14 LUFS ranzukommen. Keiner kann dir genau sagen, welche Algorithmen YT da anwendet.

Kann sein, dass wenn du viele Short Term Peaks, die deutlich über 14 LU liegen, in deinem Track hast, YT der Ansicht ist, dass das zu laut ist, obwohl du über die gesamte Timeline gesehen -14 LUFS einhälst.

Ich gehe nicht davon aus, aber mit Sicherheit sagen, kann ich es dir nicht.

Wenn deine blaue Loudness History Linie unter -14 LUFS am Ende noch ein bisschen Luft von 3 dB oder auch mehr hat, ist das sicherlich kein Schaden.

Ich denke eine gute Balance der Lautstärke zwischen Musik und Sprache, sowie ein gleichmäßiges Level über all deine (zukünftigen) Videos ist sehr viel wichtiger als den nächsten Loudness War zu gewinnen. Orientiere dich also am besten daran, ein Level zu finden, dass für dich funktioniert, ohne dass du stundenlang am Volume Knöpfchen schrauben musst.

Ich kann selbst erst mehr dazu sagen, sobald ich mehr eigene Erfahrungen dazu gesammelt habe.

Bedenke auch, dass ich selbst keine typischen Voiceovers erstelle und halte dich daher ruhig an die Erfahrungswerte von Leuten, die weniger Fokus auf Musik und mehr auf Sprache haben.

Da fällt mir noch etwas ein, was dir eventuell nützen könnte (falls nicht ohnehin bekannt, aber da du neu in Davinci Resolve bist, ist es vllt nicht selbstverständlich): Compound Clips!

Angenommen, du hast deine Musik- und deine Sprachspur aufeinander angepasst, die Verhältnisse stimmen soweit, das Ducking etc. ist alles zu deiner Zufriedenheit.

Jetzt checkst du die LUFS gegen und stellst, aus welchen Gründen auch immer, fest, dass das Ganze zu laut/zu leise ist.

Jetzt fängst du an, die Musikspur anzupassen, dann die Sprache hinterher. Checkst wieder gegen, wo du bei den LUFS stehst. Nervig! Aber kein großes Thema bei zwei Audiopuren. Angenommen aber, dass du zig VoiceOver-Schnipsel hast und mehrere Music Tracks, ist das gar nicht lustig.

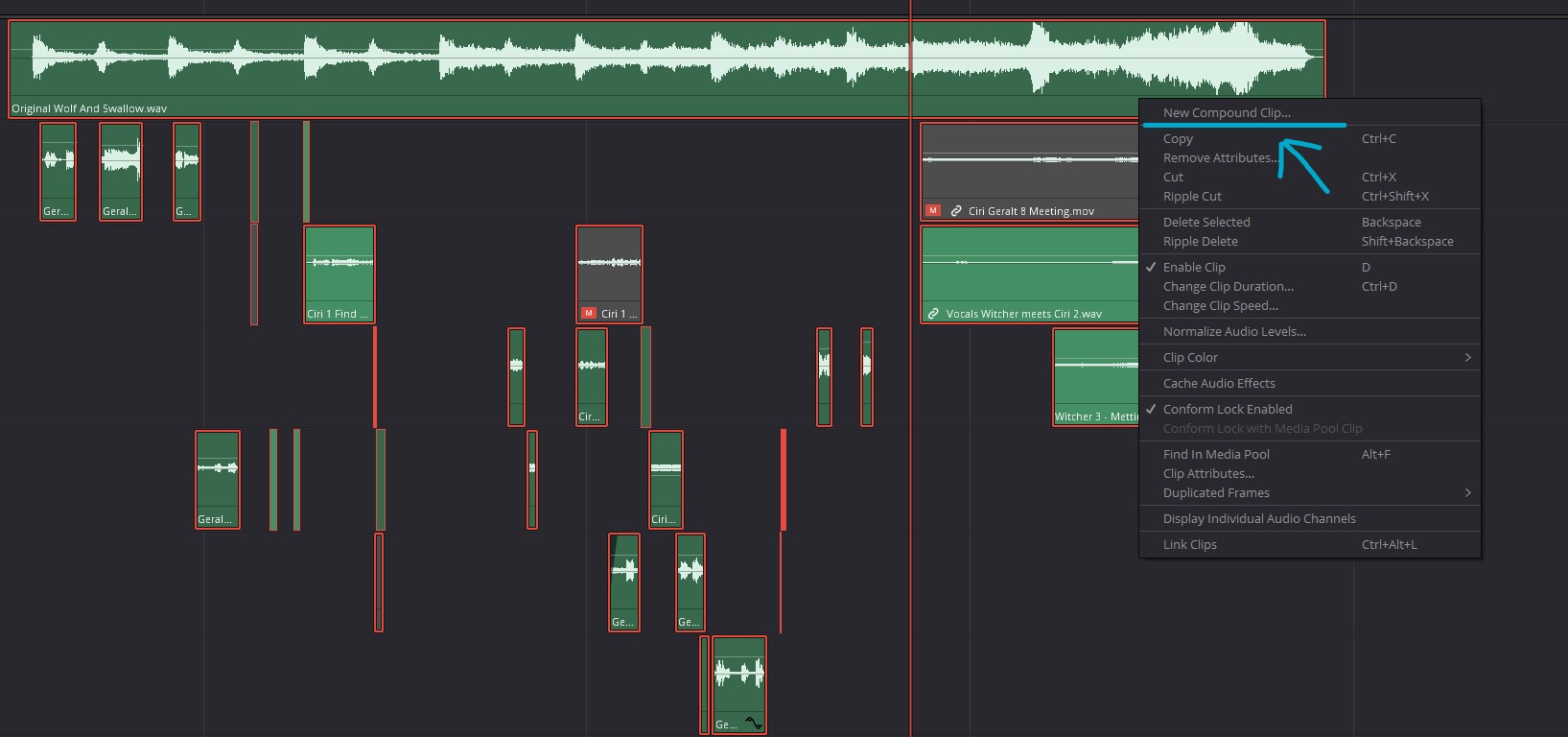

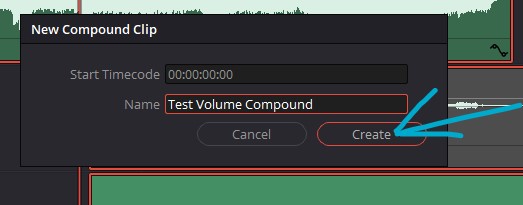

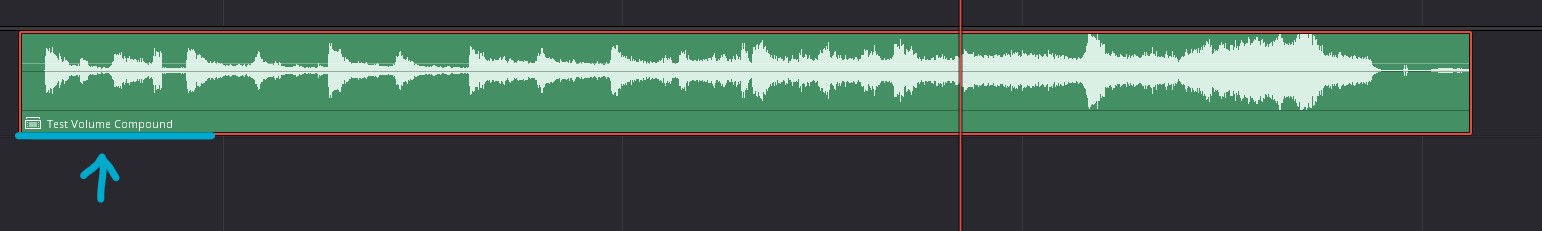

Daher, alles erstmal soweit fertig machen, alle Audiospuren im (Edit Tab) markieren, Rechtsklick, "New Compound Clip...", den Clip benennen und Voilá, schon hast du alle markierten Audiofiles zu einem einzelnen Event zusammengefügt, das sich natürlich auch über einen einzelnen Volume Regler anpassen lässt.

(Vorsicht! Wenn du die den Audiofiles zugehörigen Videospuren nicht auch vereinen möchtest, musst du vor dem Markieren der Audios das Kettensymbol "Linked Selection" (Strg+Shift+L) deaktivieren oder die Audios, die an Videos gebunden sind einzeln de-linken (Strg+Alt+L)).

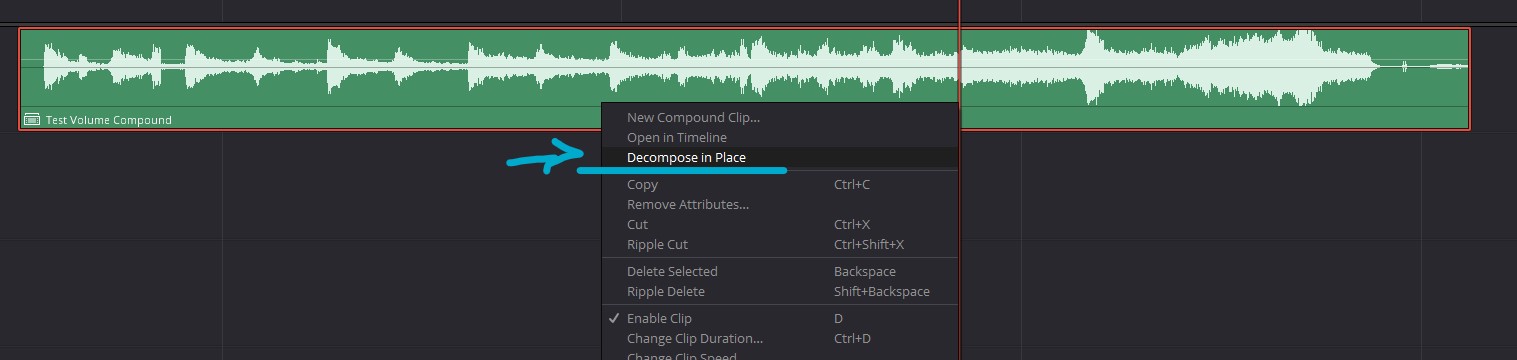

Falls du nachträglich doch noch etwas ändern möchtest, keine Tragödie. Rechtsklick auf den Compound, "Decompose in Place" und deine Audios purzeln wieder raus.

Nur für den Fall, dass dir Compounds noch neu sind.

Cheers!